Mixture-of-Experts (MoE): เหตุใด LLMs ในปี 2026 จึงเลือกประสิทธิภาพ

ค้นพบเหตุผลที่ Mixture-of-Experts (MoE) เข้ามาแทนที่โมเดลแบบหนาแน่นในปี 2026 เรียนรู้ว่าสถาปัตยกรรม MoE ช่วยเพิ่มประสิทธิภาพของ LLM และลดต้นทุนการอนุมานได้อย่างไร

สรุปสั้น: ในปี 2026 สถาปัตยกรรม Mixture-of-Experts (MoE) กลายเป็นมาตรฐานใหม่แทนที่โมเดลแบบหนาแน่น โดยลดต้นทุนการอนุมานเหลือเพียง 1/10 และเพิ่มประสิทธิภาพได้ 10 เท่า โมเดลชั้นนำอย่าง GPT-5 และ DeepSeek-V3 ใช้กลไกนี้เปิดใช้งานพารามิเตอร์เพียง 5–15% ต่อโทเค็นเพื่อลดการใช้ทรัพยากร

ข้อเท็จจริงสำคัญ

- โมเดล MoE เปิดใช้งานพารามิเตอร์เพียง 5–15% ต่อโทเค็น ผ่านกลไกตัวเราเตอร์ (router) แบบ top-k แทนการใช้ 100% เหมือนโมเดลแบบหนาแน่น

- โมเดล MoE 8 ทาง มีต้นทุนการถอดรหัส (decoding) สำหรับบริบทสั้นๆ เทียบเท่าโมเดลแบบหนาแน่นที่มีขนาดเพียงครึ่งหนึ่ง

- บนฮาร์ดแวร์ NVIDIA GB200 NVL72 โมเดล Kimi K2 Thinking แสดงประสิทธิภาพเพิ่มขึ้น 10 เท่าเมื่อเทียบกับรุ่นก่อนหน้า

- โมเดล MoE ลดต้นทุนต่อโทเค็นลงเหลือเพียง 1/10 ของโมเดลแบบหนาแน่นรุ่นก่อนหน้า

- 10 โมเดลโอเพนซอร์สที่ฉลาดที่สุดบนตารางคะแนนของ Artificial Analysis ในปี 2026 ล้วนใช้สถาปัตยกรรม MoE รวมถึง DeepSeek-R1 และ Mistral Large 3

- โมเดลแบบหนาแน่นยังคงเป็นทางเลือกหลักสำหรับการอนุมานแบบท้องถิ่น (local inference) และอุปกรณ์ขอบ (edge devices) เนื่องจากต้องการ VRAM ต่ำกว่า

- ความเสี่ยงหลักของ MoE คือ ‘การล่มสลายของผู้เชี่ยวชาญ’ (expert collapse) ซึ่งผู้เชี่ยวชาญเพียงไม่กี่ตัวรับภาระงานส่วนใหญ่

จุดสิ้นสุดของยุคโมเดลความหนาแน่นสูง

ตลอดหลายปีที่ผ่านมา แนวคิดหลักในการพัฒนาโมเดลภาษาขนาดใหญ่ (LLM) คือความหนาแน่น (density) สมมติฐานนั้นเรียบง่าย: เพื่อให้ฉลาดขึ้น คุณต้องมีพารามิเตอร์มากขึ้น และพารามิเตอร์ทุกตัวต้องถูกเปิดใช้งานสำหรับทุกโทเค็น (token) อย่างไรก็ตาม ภายในปี 2026 โมเดลนี้ได้พังทลายลงอย่างมีประสิทธิภาพที่แนวหน้าของเทคโนโลยี อุตสาหกรรมได้เปลี่ยนผ่านอย่างชัดเจนไปสู่สถาปัตยกรรมแบบ Mixture-of-Experts (MoE) ไม่ใช่เพียงเป็นทางเลือกในการทดลอง แต่เป็นมาตรฐานเริ่มต้นสำหรับ AI ประสิทธิภาพสูง

การเปลี่ยนผ่านนี้ไม่ใช่แค่ความชอบทางเทคนิค แต่เป็นความจำเป็นทางเศรษฐกิจ เมื่อต้นทุนในการฝึกและรันโมเดลที่มีพารามิเตอร์ระดับล้านล้านตัวกลายเป็นเรื่อง prohibitively สูง MoE จึงเสนอทางออก โดยเปิดใช้งานเฉพาะกลุ่มย่อยเล็กๆ ของ “ผู้เชี่ยวชาญ” (experts) ที่เชี่ยวชาญเฉพาะด้านต่อโทเค็น โมเดลเหล่านี้จึงสามารถบรรลุระดับความฉลาดที่แนวหน้าได้ ในขณะที่เปิดใช้งานพารามิเตอร์เพียง 10–40 พันล้านตัว [1][3] สิ่งนี้แสดงถึงการเปลี่ยนแปลงพื้นฐานในเศรษฐศาสตร์ของ AI ซึ่งทำให้สามารถขยายขนาดได้อย่างมหาศาลโดยไม่ต้องจ่ายค่าคอมพิวติ้งที่สูงลิ่ว

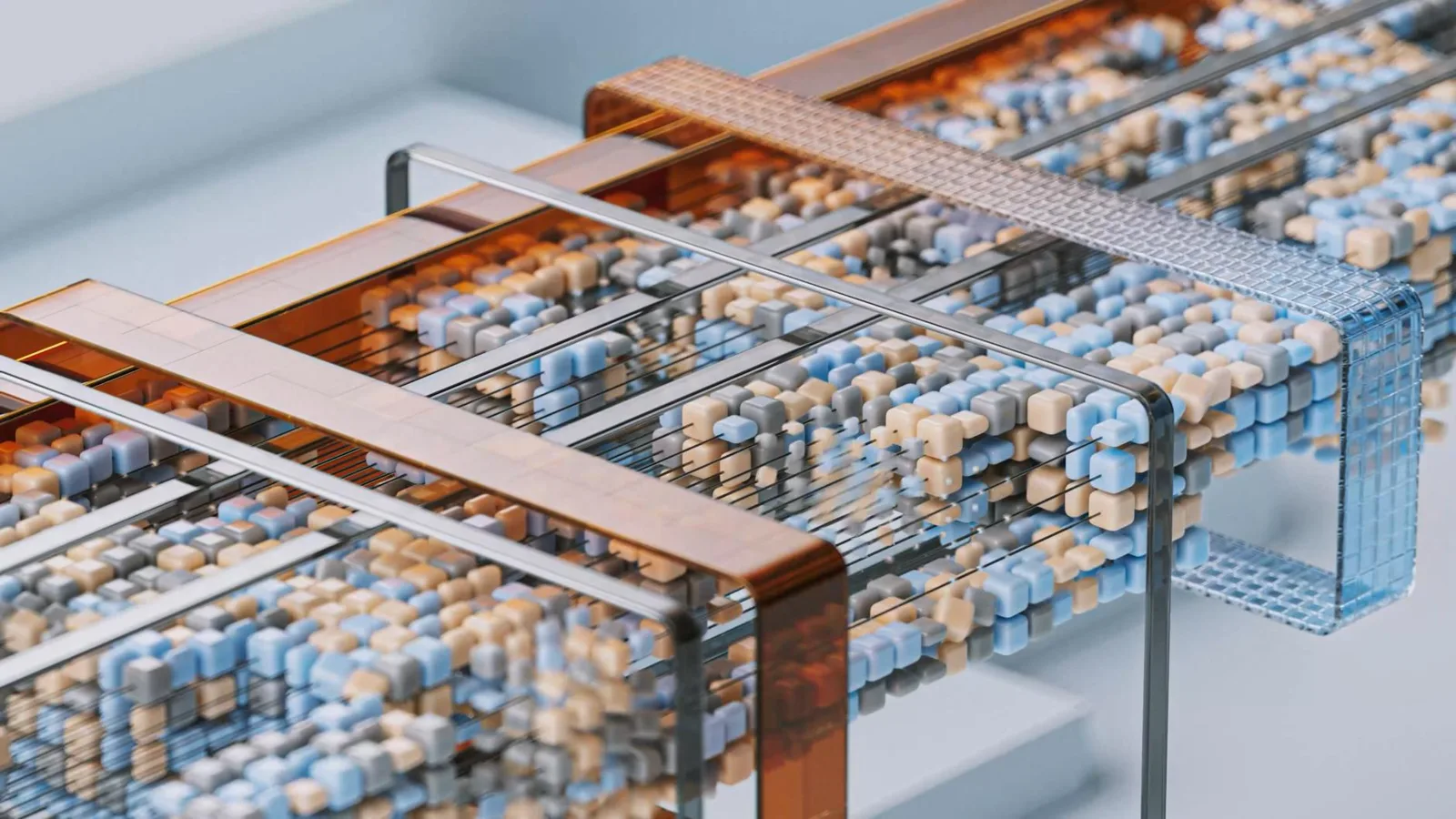

กลไกของการคำนวณแบบมีเงื่อนไข

เพื่อเข้าใจว่าทำไม MoE จึงชนะ เราต้องมองไปที่กลไกการทำงาน ในโมเดลความหนาแน่นสูงแบบดั้งเดิม พารามิเตอร์ 100% จะถูก задейใช้สำหรับทุกอินพุต [1][2] ในทางตรงกันข้าม โมเดล MoE จะใช้ตัวเราเตอร์ (router) ที่เรียนรู้ได้ เพื่อเปิดใช้งานเพียง 5–15% ของพารามิเตอร์ทั้งหมดต่อโทเค็น ผ่านการกำหนดเส้นทางแบบ top-k [1][2] การเปิดใช้งานแบบเลือกสรรนี้คือหัวใจของแนวคิด “การคำนวณแบบมีเงื่อนไข” (conditional computation) ซึ่งตอนนี้ได้พัฒนาจนพร้อมสำหรับการใช้งานจริงในเชิงพาณิชย์ [7]

การเพิ่มประสิทธิภาพนั้นน่าทึ่ง โมเดลอย่าง DeepSeek-V3, MiniMax M2.5 และ GPT-5 ใช้สถาปัตยกรรมนี้เพื่อส่งมอบประสิทธิภาพที่เหนือกว่าโมเดลความหนาแน่นสูงที่มีขนาดใหญ่กว่ามาก [1][3] กฎคร่าวๆ ในอุตสาหกรรมปัจจุบันชี้ว่า โมเดล MoE แบบ sparse 8 ทาง มีเศรษฐศาสตร์ในการถอดรหัส (decoding) สำหรับบริบทสั้นๆ เทียบเท่ากับโมเดลความหนาแน่นสูงที่มีขนาดเพียงครึ่งหนึ่ง [5] นอกจากนี้ โมเดล MoE มักจะตื้นกว่าและกว้างกว่าโมเดลความหนาแน่นสูง counterparts ของพวกมัน ทำให้ต้องการการสื่อสารผ่านเครือข่ายน้อยลงในแต่ละรอบการคำนวณไปข้างหน้า (forward pass) ซึ่งช่วยเร่งความเร็วในการอนุมาน (inference) ได้มากขึ้น [5]

ผลกระทบทางเศรษฐกิจ: ประสิทธิภาพเพิ่มขึ้น 10 เท่า ต้นทุนลดลงเหลือ 1/10

ปัจจัยหลักที่ขับเคลื่อนการเปลี่ยนแปลงทางสถาปัตยกรรมนี้คือต้นทุน ในปี 2026 ความสามารถในการรันโมเดลขนาดใหญ่อย่างมีประสิทธิภาพคือป้อมปราการทางธุรกิจ การวิเคราะห์ในอุตสาหกรรมชี้ให้เห็นว่าโมเดลโอเพนซอร์สที่ฉลาดที่สุด 10 อันดับแรกบนตารางคะแนนของ Artificial Analysis ล้วนใช้สถาปัตยกรรม MoE รวมถึง DeepSeek-R1, Kimi K2 Thinking และ Mistral Large 3 [4]

ระบบนิเวศของฮาร์ดแวร์ได้ปรับตัวตามความเป็นจริงนี้ บนฮาร์ดแวร์ที่ผ่านการปรับแต่งเช่น NVIDIA GB200 NVL72 โมเดล MoE อย่าง Kimi K2 Thinking แสดงให้เห็นถึงกระโดดของประสิทธิภาพ 10 เท่าเมื่อเทียบกับรุ่นก่อนหน้า [4] การเร่งความเร็วด้วยฮาร์ดแวร์นี้ทำให้ต้นทุนต่อโทเคนลดลงเหลือหนึ่งในสิบของโมเดลแบบหนาแน่นรุ่นก่อนหน้า [4] สำหรับเอเจนต์บนคลาวด์ การทำงานอัตโนมัติด้านโค้ด และงานที่ต้องใช้บริบทยาวนาน ประสิทธิภาพนี้ไม่ใช่แค่โบนัส แต่เป็นข้อกำหนดที่จำเป็น [1]

ด้านมืดของความเชี่ยวชาญ

อย่างไรก็ตาม ปฏิวัติ MoE ก็ไม่ปราศจากความซับซ้อน ความเข้าใจผิดที่พบบ่อยคือผู้เชี่ยวชาญใน MoE จะเชี่ยวชาญในโดเมนที่มนุษย์อ่านเข้าใจได้ เช่น “การเขียนโค้ด” หรือ “ประวัติศาสตร์” ในความเป็นจริง ผู้เชี่ยวชาญมักจะทำการเลือกเส้นทาง (route) ตามรูปแบบระดับโทเคนที่เป็นนามธรรม ทำให้การปรับสมดุลโหลดเป็นความท้าทายในการฝึกฝนที่ซับซ้อน [3] โมเดลไม่ได้จำเป็นต้องมี “ผู้เชี่ยวชาญด้านคณิตศาสตร์” และ “ผู้เชี่ยวชาญด้านการเขียน” ในแบบที่ทีมมนุษย์มี แต่มีเส้นทางคำนวณเฉพาะทางที่ถูกกระตุ้นตามความน่าจะเป็นทางสถิติ [3]

การเป็นนามธรรมนี้ทำให้โมเดล MoE เข้าใจและดีบักได้ยากกว่าโมเดลแบบหนาแน่น กลไกการเลือกเส้นทางอาจไม่ชัดเจน และการการันตีว่าผู้เชี่ยวชาญจะถูกใช้งานอย่างเท่าเทียมกันระหว่างการฝึกฝนต้องใช้เทคนิคที่ซับซ้อนเพื่อป้องกัน “การล่มสลายของผู้เชี่ยวชาญ” (expert collapse) ซึ่งผู้เชี่ยวชาญเพียงไม่กี่ตัวต้องรับภาระงานส่วนใหญ่ ในขณะที่ตัวอื่นๆ ว่างงาน [3]

พื้นที่ที่โมเดลแบบหนาแน่นยังคงครองราชย์

แม้ว่า MoE จะครองตลาดบนคลาวด์ แต่โมเดลแบบหนาแน่นก็ยังไม่ตายไปจากโลกนี้ พวกเขายังคงเป็นตัวเลือกแรกสำหรับการอนุมานแบบท้องถิ่น (local inference) การปรับแต่งอย่างหนัก (heavy fine-tuning) และแอปพลิเคชันแชทที่ไวต่อความล่าช้า [1][2] ความเรียบง่ายและความเสถียรของโมเดลแบบหนาแน่น รวมกับความต้องการ VRAM ที่ต่ำกว่า ทำให้พวกเขาเหมาะสำหรับอุปกรณ์ขอบ (edge devices) และสถานการณ์ที่ความน่าเชื่อถือสำคัญกว่าขนาดดิบ [1][2]

สำหรับนักพัฒนาที่ทำงานกับแอปพลิเคชัน AI แบบท้องถิ่น โมเดลแบบหนาแน่น (dense model) ยังคงเป็นทางเลือกที่สมเหตุสมผลที่สุด เนื่องจากต้นทุนในการจัดการการกระตุ้นแบบเบาบาง (sparse activations) และการกำหนดเส้นทาง (routing) นั้นไม่คุ้มค่าสำหรับการใช้งานในขนาดเล็ก อย่างไรก็ตาม สำหรับขอบเขตความก้าวหน้าของ AI ที่ซึ่งความฉลาดและขนาดมีความสำคัญสูงสุด MoE ก็เป็นผู้ชนะ

บทสรุป

การเปลี่ยนผ่านสู่สถาปัตยกรรม MoE ในปี 2026 สะท้อนถึงวุฒิภาวะของวงการนี้ เราได้ก้าวผ่านยุคของการขยายขนาดแบบใช้กำลังดิบ (brute-force scaling) เข้าสู่ยุคของประสิทธิภาพที่ชาญฉลาด แม้โมเดลแบบหนาแน่นจะยังคงให้บริการแอปพลิเคชันเฉพาะทางต่อไป แต่ขอบเขตความก้าวหน้าของ AI ในปัจจุบันถูกนิยามด้วยความสามารถในการกระตุ้นเฉพาะสิ่งที่จำเป็นเท่านั้น เมื่อฮาร์ดแวร์ยังคงได้รับการปรับปรุงให้เหมาะสมกับการคำนวณแบบเบาบาง ช่องว่างระหว่างโมเดล MoE และโมเดลแบบหนาแน่นจะยิ่งกว้างขึ้น ทำให้ MoE เป็นค่าเริ่มต้นสำหรับระบบอัจฉริยะรุ่นต่อไป

การผงาดขึ้นของ MoE ไม่ใช่เพียงวิวัฒนาการทางเทคนิคเท่านั้น แต่ยังเป็นภาพสะท้อนการตอบสนองของอุตสาหกรรมต่อความเป็นจริงทางเศรษฐกิจ ด้วยการกระตุ้นพารามิเตอร์เพียง 5–15% โมเดลอย่าง GPT-5 และ DeepSeek-V3 ได้พิสูจน์แล้วว่าความฉลาดไม่ได้ขึ้นอยู่กับจำนวนพารามิเตอร์ที่มากกว่า แต่ขึ้นอยู่กับวิธีการใช้พารามิเตอร์เหล่านั้นอย่างชาญฉลาด [3] เมื่อเราก้าวไปข้างหน้า จุดสนใจจะเปลี่ยนจากการเพิ่มจำนวนผู้เชี่ยวชาญ (experts) เข้าไปเรื่อยๆ เป็นการปรับปรุงกลไกการกำหนดเส้นทางที่เชื่อมโยงพวกเขา เพื่อให้มั่นใจว่าทุกโทเค็น (token) จะได้รับการประมวลผลโดยผู้เชี่ยวชาญที่เกี่ยวข้องที่สุดในเครือข่าย

แหล่งข้อมูล

- MoE vs Dense Models: 2026 Reality for LLMs | Vijay Krishna Gudavalli posted on the topic | LinkedIn (www.linkedin.com) — 2026-02-17

- Mixture of Experts Reshaping AI in 2026 with GPT-5 and DeepSeek-V3 | Gaurvi Vishnoi posted on the topic | LinkedIn (www.linkedin.com) — 2026-04-18

- Dense vs. MoE: Understand the Differences - Red Stapler (redstapler.co) — 2026-01-14

- Mixture-of-Experts (MoE): The Birth and Rise of Conditional Computation (cameronrwolfe.substack.com) — 2024-03-18

- MoE vs AI dense models: How do they compare in inference? (epoch.ai) — 2024-12-20

- Mixture of Experts Powers the Most Intelligent Frontier AI Models, Runs 10x Faster to Deliver 1/10 the Token Cost on NVIDIA Blackwell NVL72 (blogs.nvidia.com) — 2025-12-03