moe llm ai-architecture

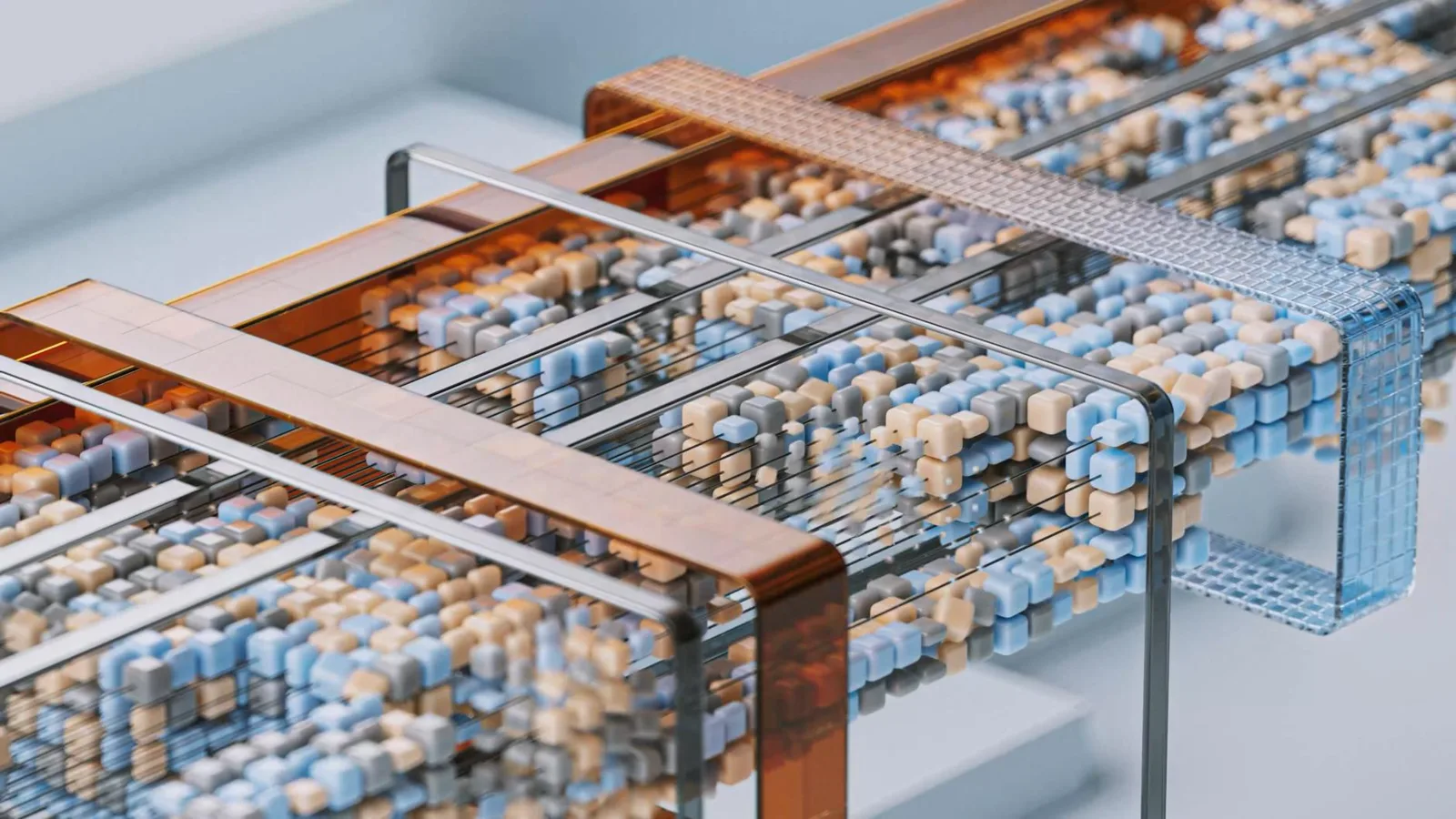

Mixture-of-Experts (MoE): เหตุใด LLMs ในปี 2026 จึงเลือกประสิทธิภาพ

ค้นพบเหตุผลที่ Mixture-of-Experts (MoE) เข้ามาแทนที่โมเดลแบบหนาแน่นในปี 2026 เรียนรู้ว่าสถาปัตยกรรม MoE ช่วยเพิ่มประสิทธิภาพของ LLM และลดต้นทุนการอนุมานได้อย่างไร

· 35 นาทีในการอ่าน