local-llm benchmark qwen3

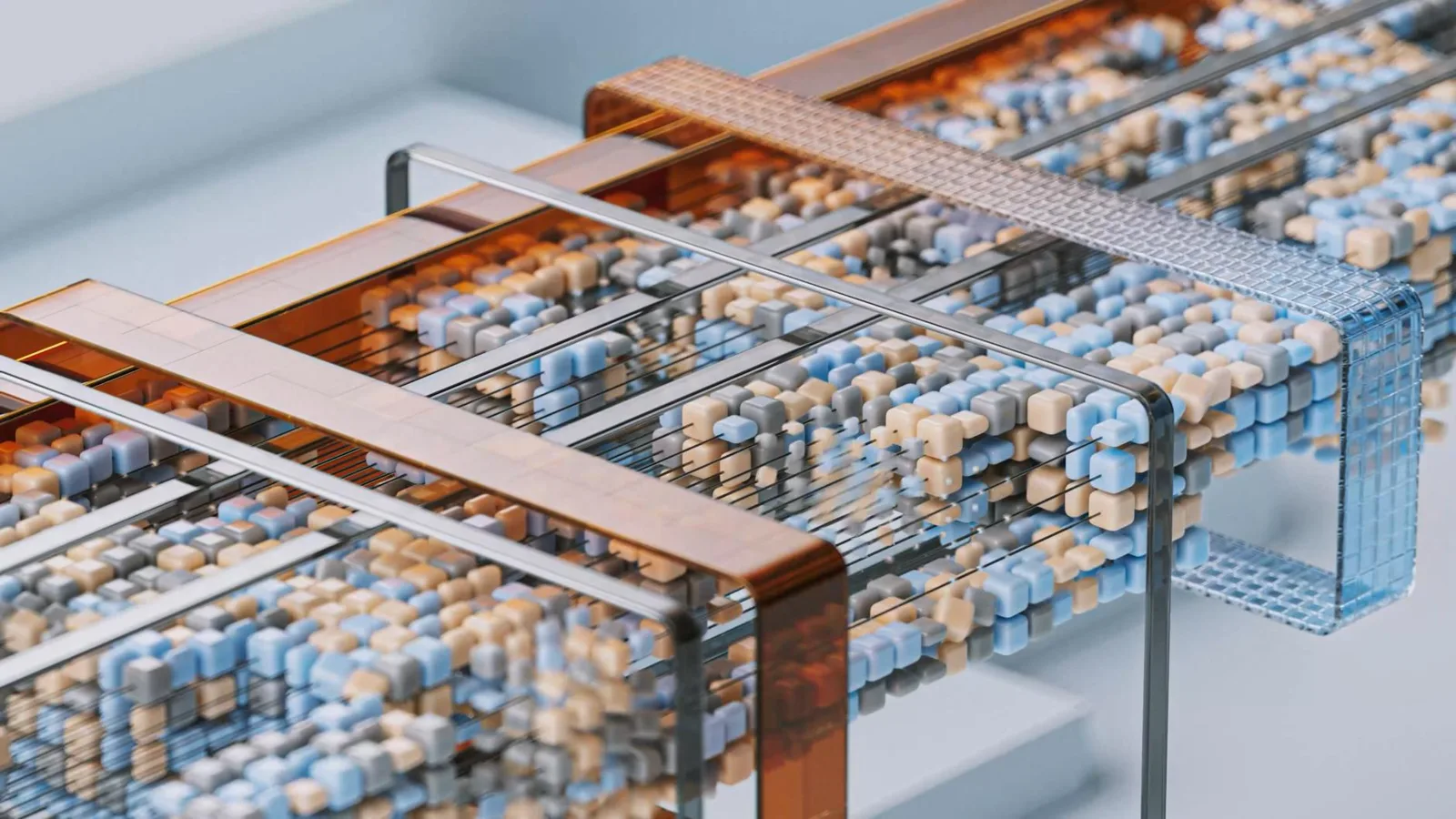

ทดสอบ LLM ในเครื่องบน Dual-GPU 48 GB: รุ่นไหนใช้ได้จริงในปี 2026

เราทดสอบ Qwen3 27B, 32B, 35B-A3B, และ 80B บนเครื่อง RTX 5090 + 5080 ของเราเอง เพื่อหาจุดคุ้มค่าจริงสำหรับรัน AI ในเครื่องปี 2026 นี่คือรุ่นที่เราเก็บไว้ใช้ — และรุ่นที่ปลดระวาง

· 26 นาทีในการอ่าน