Gemma 4 VLA บน Jetson Orin Nano Super: ศักยภาพและข้อจำกัด

เจาะลึกการรัน Gemma 4 VLA บน Jetson Orin Nano Super พบศักยภาพ AI ขอบเขต แต่ยังมีปัญหา CUDA out-of-memory ที่ต้องแก้ไข

สรุปสั้น: การสาธิตโมเดล Gemma 4 VLA บน Jetson Orin Nano Super เมื่อวันที่ 22 เมษายน 2026 แสดงให้เห็นศักยภาพในการประมวลผลภาพและเสียงแบบเรียลไทม์ แต่พบปัญหาความจำ CUDA ไม่เพียงพอเมื่อใช้โมเดลขนาด e4b ซึ่งต้องการพื้นที่ว่างอย่างน้อย 1,024 MiB ในขณะที่ระบบมี VRAM ใช้งานได้จริงเพียง 7,619 MiB

ข้อเท็จจริงสำคัญ

- การสาธิต Gemma 4 VLA บน Jetson Orin Nano Super ถูกเผยแพร่เมื่อวันที่ 22 เมษายน 2026 ผ่านบล็อกของ Hugging Face

- ระบบประกอบด้วย Pipeline 3 ส่วนหลัก ได้แก่ Parakeet STT, Gemma 4 และ Kokoro TTS เพื่อประมวลผลเสียงและภาพ

- โมเดล Gemma 4 สามารถตัดสินใจเปิดใช้กล้อง Logitech C920 เพื่อวิเคราะห์บริบทภาพแบบเรียลไทม์โดยไม่ต้องใช้ Keyword Triggers

- Jetson Orin Nano Super มีหน่วยความจำ VRAM รวม 7,619 MiB แต่โมเดล Gemma 4 e4b ต้องการพื้นที่ประมาณ 5,533 MiB

- การติดตั้งล้มเหลวเนื่องจากขาดพื้นที่ความจำว่าง (Free Memory) อย่างน้อย 1,024 MiB ตามข้อกำหนดของระบบ CUDA

- นักพัฒนาสามารถรันโมเดลได้เฉพาะในโหมด CPU-only แต่จะล้มเหลวทันทีเมื่อพยายามใช้งาน GPU

- โค้ดสาธิตแบบเต็มรูปแบบถูกเปิดให้ชุมชนเข้าถึงได้ที่ GitHub repository ชื่อ asierarranz/Google_Gemma

บทสรุปความคืบหน้า: การสาธิต Gemma 4 VLA บนฮาร์ดแวร์ราคาประหยัด

เมื่อวันที่ 22 เมษายน 2026 ได้มีการนำเสนอการสาธิตการทำงานของโมเดล Google Gemma 4 Vision-Language-Action (VLA) บนชิปประมวลผล NVIDIA Jetson Orin Nano Super ซึ่งเป็นการแสดงให้เห็นถึงศักยภาพของการนำปัญญาประดิษฐ์แบบหลายรูปแบบ (Multimodal AI) ไปใช้งานบนอุปกรณ์ขอบ (Edge Hardware) ที่มีขนาดกะทัดรัดและราคาเข้าถึงได้ [1][3] การสาธิตนี้ถูกเผยแพร่ผ่านบล็อกของ Hugging Face โดยเน้นที่ความสามารถของระบบในการประมวลผลคำสั่งเสียง ตีความผ่านโมเดลภาษา และตอบสนองกลับด้วยเสียง โดยมีการบูรณาการกล้องเว็บแคมเพื่อวิเคราะห์บริบทภาพแบบเรียลไทม์ [3]

อย่างไรก็ตาม การสาธิตที่ประสบความสำเร็จนี้ตั้งอยู่บนความท้าทายทางเทคนิคที่ผู้ใช้ในชุมชนนักพัฒนาต้องเผชิญ นั่นคือข้อจำกัดด้านหน่วยความจำ (Memory) ที่ทำให้การติดตั้งโมเดลขนาดใหญ่บนฮาร์ดแวร์ระดับเริ่มต้นอาจไม่เสถียรเท่าที่ควร หากไม่มีการปรับแต่งการตั้งค่าอย่างเหมาะสม [4][5]

สถาปัตยกรรมระบบและการทำงานอัตโนมัติ

การสาธิตดังกล่าวไม่ได้เป็นเพียงการรันโมเดลภาษาขนาดใหญ่ (LLM) ทั่วไป แต่เป็นระบบ VLA ที่สามารถโต้ตอบกับสภาพแวดล้อมทางกายภาพได้ ระบบที่นำเสนอใช้ Pipeline การทำงานที่เชื่อมโยงกัน 3 ส่วนหลัก ได้แก่:

- Parakeet STT: ทำหน้าที่แปลงเสียงพูดของผู้ใช้ให้เป็นข้อความ (Speech-to-Text)

- Gemma 4: ทำหน้าที่ประมวลผลข้อความและตัดสินใจว่าจะต้องดึงข้อมูลภาพจากกล้องเว็บแคมหรือไม่

- Kokoro TTS: แปลงคำตอบจากโมเดลกลับเป็นเสียงพูด (Text-to-Speech)

จุดเด่นสำคัญของระบบนี้คือความ “อัตโนมัติ” ในการตัดสินใจใช้ข้อมูลภาพ โมเดล Gemma 4 สามารถวิเคราะห์คำถามของผู้ใช้และตัดสินใจเปิดใช้งานกล้อง Logitech C920 เพื่อรับบริบทภาพเมื่อจำเป็น โดยไม่ต้องอาศัย Keyword Triggers หรือ Logic ที่ถูกกำหนดตายตัว (Hardcoded) [3] ระบบนี้จึงสามารถตอบคำถามที่อ้างอิงจากสิ่งที่เห็นในกล้องแบบเรียลไทม์ได้ ซึ่งเป็นการลดความจำเป็นในการพึ่งพาเซิร์ฟเวอร์กลางสำหรับการประมวลผลภาพในบางสถานการณ์ [3]

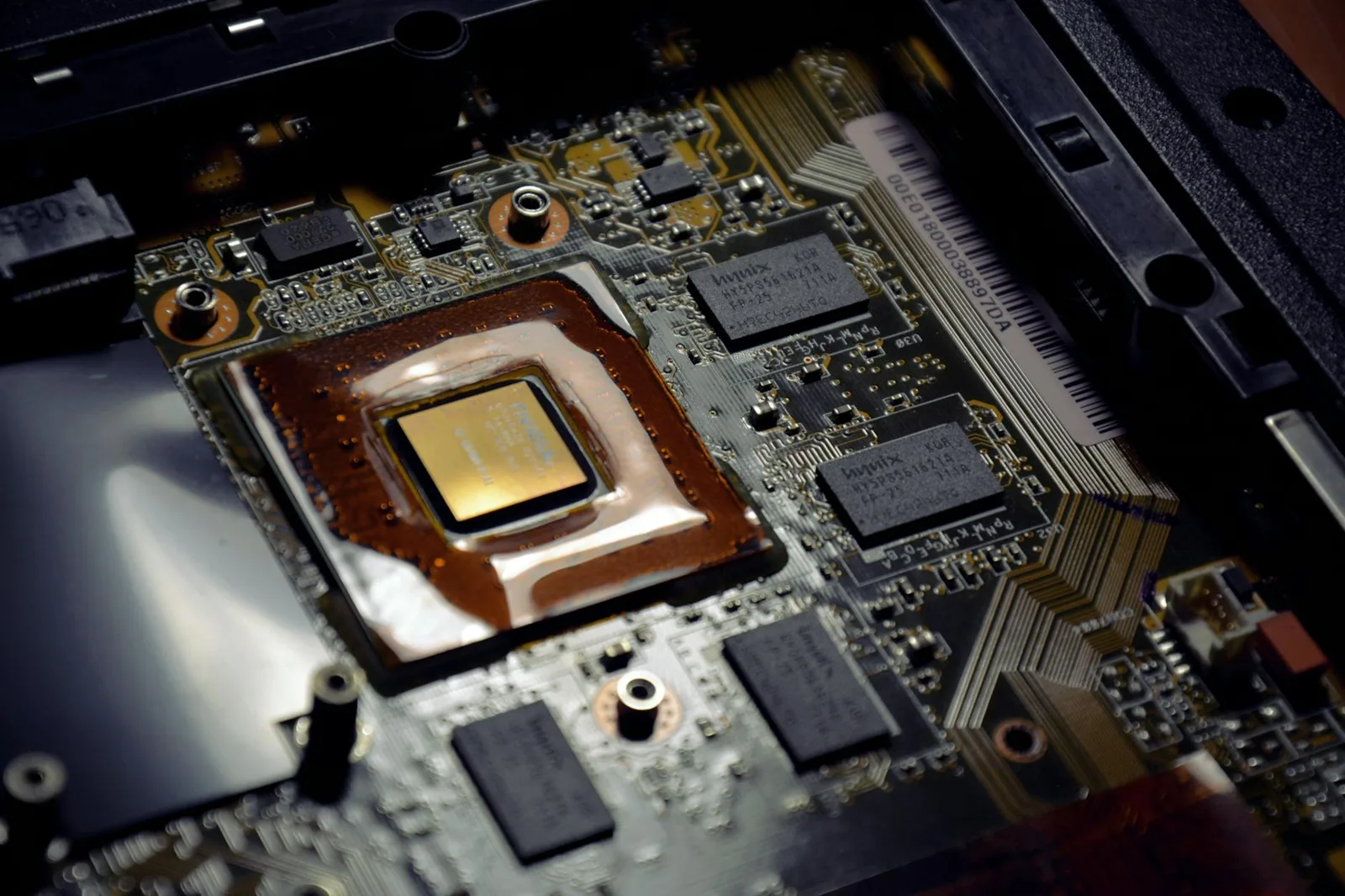

ฮาร์ดแวร์ที่ใช้ในการสาธิตที่ประสบความสำเร็จประกอบด้วย NVIDIA Jetson Orin Nano Super ที่มีหน่วยความจำ 8 GB, กล้อง Logitech C920 พร้อมไมโครโฟนในตัว และอุปกรณ์ต่อพ่วงมาตรฐานอื่นๆ [3] โค้ดสคริปต์เต็มรูปแบบสำหรับการสาธิตนี้ถูกเปิดเผยให้ชุมชนนักพัฒนาสามารถนำไปศึกษาและปรับใช้ต่อได้ผ่าน GitHub ใน repository ชื่อ asierarranz/Google_Gemma [3]

ความท้าทายด้านหน่วยความจำ: ความเป็นจริงในสนาม

แม้ว่าการสาธิตจะประสบความสำเร็จ แต่ในทางปฏิบัติ นักพัฒนาที่พยายามนำโมเดล Gemma 4 รุ่น e4b ไปรันบน Jetson Orin Nano Super ผ่าน Docker และ llama.cpp ได้รายงานปัญหาเรื่อง “CUDA out-of-memory” อย่างต่อเนื่อง [4][5]

จากการตรวจสอบบันทึกข้อผิดพลาด (Error Logs) ในฟอรัมผู้พัฒนาของ NVIDIA เมื่อช่วงต้นเดือนเมษายน 2026 พบว่า:

- Jetson Orin Nano Super ในกรณีทดสอบมีหน่วยความจำ VRAM รวมอยู่ที่ 7,619 MiB [4][5]

- ระบบประมาณการว่าโมเดล Gemma 4 e4b จะใช้หน่วยความจำของอุปกรณ์ (Device Memory) ประมาณ 5,533 MiB [4][5]

- อย่างไรก็ตาม ระบบล้มเหลวในการรักษาพื้นที่หน่วยความจำว่าง (Free Memory) ให้เหลืออย่างน้อย 1,024 MiB ตามเกณฑ์ที่ต้องการ [4][5]

ผลที่ตามมาคือระบบไม่สามารถโหลดโมเดลได้เต็มรูปแบบบน GPU นักพัฒนาคนหนึ่งระบุว่า โมเดลสามารถทำงานได้เมื่อตั้งค่าให้ใช้ CPU-only mode แต่จะล้มเหลวทันทีเมื่อพยายามเปิดใช้งาน GPU [5] ปัญหาเหล่านี้ชี้ให้เห็นว่า แม้สเปกทางทฤษฎีจะดูเหมือนว่าหน่วยความจำ 8 GB (หรือ 7.6 GB ที่ใช้งานได้จริง) จะเพียงพอ แต่ในทางปฏิบัติ การจัดการทรัพยากรสำหรับโมเดล VLA ที่ต้องโหลดทั้งโมเดลภาษาและส่วนประมวลผลภาพ อาจต้องการการปรับแต่งที่ละเอียดอ่อนกว่านั้น [4][5]

บทวิเคราะห์: ทางออกสำหรับ Edge AI ในอุตสาหกรรม

ความขัดแย้งระหว่างการสาธิตที่ราบรื่นกับความล้มเหลวในหน่วยความจำสะท้อนถึง “ช่องว่าง” (Gap) ที่สำคัญในการนำ AI ขอบเขตไปใช้งานจริง [1][3] สำหรับอุตสาหกรรมเช่นคลังสินค้าหรือค้าปลีกที่ต้องการใช้ AI วิเคราะห์เอกสารหรือรูปภาพบนอุปกรณ์ขนาดเล็ก การพึ่งพาโมเดลขนาดใหญ่โดยไม่มีการบีบอัด (Quantization) หรือการปรับแต่งสถาปัตยกรรมอาจทำให้ต้นทุนและเวลาในการพัฒนาเพิ่มขึ้นอย่างมาก [1][3]

อย่างไรก็ตาม การมีอยู่ของการสาธิตที่ประสบความสำเร็จแสดงให้เห็นว่า เป็นไปได้ที่จะรันระบบ VLA ขั้นสูงบนชิปราคาประหยัด หากมีการจัดการทรัพยากรอย่างมีประสิทธิภาพ [1][3] การเรียนรู้จากข้อผิดพลาดของชุมชนนักพัฒนาเรื่องหน่วยความจำ จะช่วยให้นักพัฒนาในอนาคตสามารถออกแบบ Pipeline ที่เหมาะสมกับข้อจำกัดของฮาร์ดแวร์ Jetson Orin Nano Super ได้ดียิ่งขึ้น [4][5]

สำหรับนักพัฒนาที่สนใจทดลองใช้งาน สามารถติดตามโค้ดและวิธีการตั้งค่าเพิ่มเติมจากแหล่งข้อมูลหลักที่ Hugging Face และ GitHub ซึ่งจะเป็นกุญแจสำคัญในการก้าวข้ามข้อจำกัดด้านฮาร์ดแวร์ในปัจจุบัน [3]

Sources

- Gemma 4 VLA Demo on Jetson Orin Nano Super (www.aiforesights.com) — 2026-04-22

- Gemma 4 VLA Demo on Jetson Orin Nano Super (huggingface.co) — 2026-04-22

- No luck with Gemma 4 on Jetson Nano Super (forums.developer.nvidia.com) — 2026-04-04

- Gemma4 e4b on Jetson Orin Nano fails due to CUDA out of memory issue (forums.developer.nvidia.com) — 2026-04-05