Google DeepMind เปิดตัว Gemini Robotics-ER 1.6 หุ่นยนต์ AI อัจฉริยะ

Google DeepMind เปิดตัว Gemini Robotics-ER 1.6 เพิ่มความสามารถหุ่นยนต์ AI อ่านเกจวัดและวางแผนการเคลื่อนไหวในสภาพแวดล้อมจริงอย่างแม่นยำ

สรุปสั้น: Google DeepMind เปิดตัว Gemini Robotics-ER 1.6 ซึ่งเป็นโมเดลภาษาภาพ (Vision-Language Model) ที่ออกแบบมาเพื่อเพิ่มความสามารถในการให้เหตุผลเชิงกายภาพ (Embodied Reasoning) ให้หุ่นยนต์สามารถเข้าใจสภาพแวดล้อม วางแผนการเคลื่อนไหว และตรวจจับความสำเร็จของงานได้อย่างแม่นยำยิ่งขึ้น รุ่นนี้ได้รับการพัฒนาความสามารถพิเศษในการอ่านเกจวัดและเครื่องมือวัดที่ซับซ้อนผ่านการร่วมมือกับ Boston Dynamics และถูกนำมาทดสอบท

ข้อเท็จจริงสำคัญ

- Google DeepMind เปิดตัว Gemini Robotics-ER 1.6 เมื่อ 14 เมษายน 2026 เพื่อเพิ่มความสามารถในการให้เหตุผลเชิงกายภาพ (Embodied Reasoning) ให้หุ่นยนต์สามารถเข้าใจสภาพแวดล้อมและวางแผนการเคลื่อนไหวได้แม่นยำยิ่งขึ้น [1, 7]

- โมเดลนี้มีความสามารถในการอ่านเกจวัดและเครื่องมือวัดที่ซับซ้อน (Instrument Reading) ซึ่งเป็นฟีเจอร์ที่พัฒนาขึ้นจากการร่วมมือกับ Boston Dynamics [1, 7]

- Gemini Robotics-ER 1.6 ถูกกล่าวขานว่าเป็นรุ่นที่ปลอดภัยที่สุดในตระกูล ER โดยสามารถปฏิบัติตามนโยบายความปลอดภัยและหลีกเลี่ยงสิ่งกีดขวางหรือการยกของหนักเกิน 20 กก. ได้ [2, 4]

- Boston Dynamics ได้นำ Gemini Robotics-ER 1.6 ไปติดตั้งในหุ่นยนต์ Spot เพื่อใช้ตรวจสอบโรงงาน โดยสามารถอ่านรายการสิ่งที่ต้องเขียนด้วยมือและระบุอันตรายเช่นน้ำท่วมขังได้ [2, 8]

- แม้มีความก้าวหน้า แต่การสาธิตยังพบข้อจำกัดด้านการทำงานทางกายภาพ เช่น หุ่นยนต์จับกระป๋องในแนวขวาง แสดงให้เห็นว่าความเข้าใจทางกายภาพแบบมนุษย์ยังเป็นเรื่องที่ท้าทาย [8]

- โมเดลทำหน้าที่เป็นผู้ประสานงานระดับสูง (High-level Orchestrator) ที่สามารถเรียกใช้เครื่องมือภายนอกเช่น Google Search และเชื่อมต่อกับโมเดล Vision-Language-Action ของบุคคลที่สามได้ [3, 7]

- นักพัฒนาสามารถอัปเกรดจากเวอร์ชัน 1.5 เป็น 1.6 ได้ง่าย ๆ เพียงเปลี่ยนชื่อโมเดลในคำสั่ง API โดยไม่ต้องปรับโครงสร้างโค้ดใหม่ [5]

Google DeepMind ผลักดันหุ่นยนต์ด้วย Gemini Robotics-ER 1.6

Google DeepMind ได้ประกาศเปิดตัว Gemini Robotics-ER 1.6 เมื่อ 14 เมษายน 2026 ซึ่งเป็นจุดเปลี่ยนสำคัญในการพัฒนาปัญญาประดิษฐ์สำหรับหุ่นยนต์ โดยมุ่งเน้นไปที่การเพิ่มความสามารถในการ “ให้เหตุผลเชิงกายภาพ” (Embodied Reasoning) ให้แก่หุ่นยนต์ [1, 7] การอัปเกรดนี้ไม่ได้เป็นการปรับปรุงประสิทธิภาพเพียงเล็กน้อย แต่เป็นการเปลี่ยนแปลงพื้นฐานจากโมเดลที่ “ปฏิบัติตามคำสั่ง” (Command-following) ไปสู่ระบบที่สามารถ “ตีความสภาพแวดล้อมทางกายภาพ” วางแผนการเคลื่อนไหวที่ซับซ้อน และตรวจจับความสำเร็จของงานได้อย่างอัตโนมัติ [1, 7]

โมเดลนี้เป็นส่วนหนึ่งของตระกูล Gemini Robotics ที่พัฒนาขึ้นเพื่อแก้ปัญหาความท้าทายในการนำ AI ไปใช้งานในโลกจริง ซึ่งเต็มไปด้วยสิ่งกีดขวางและตัวแปรที่ไม่สามารถควบคุมได้ [7] Gemini Robotics-ER 1.6 ถูกออกแบบมาให้ทำหน้าที่เป็น “ผู้ประสานงานระดับสูง” (High-level Orchestrator) ที่มีความสามารถในการตัดสินใจเชิงกลยุทธ์ โดยสามารถเรียกใช้เครื่องมือภายนอกเช่น Google Search เพื่อค้นหาข้อมูลเพิ่มเติม หรือเชื่อมต่อกับโมเดล Vision-Language-Action ของบุคคลที่สามเพื่อปฏิบัติหน้าที่เฉพาะทาง [3, 7]

ความสามารถพิเศษ: การอ่านเกจวัดและเครื่องมือวัด

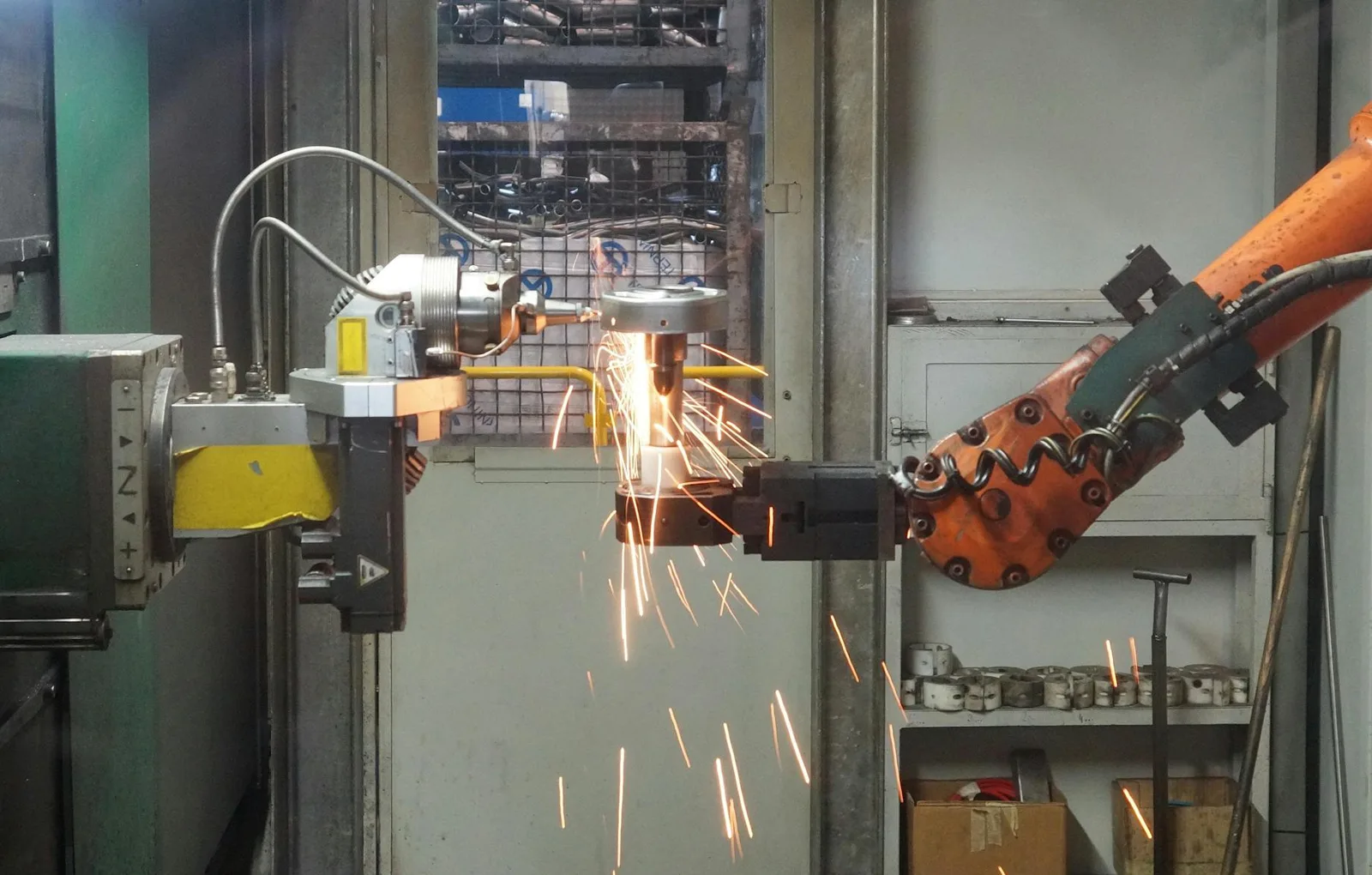

หนึ่งในฟีเจอร์ที่โดดเด่นที่สุดของ Gemini Robotics-ER 1.6 คือความสามารถในการ “อ่านเกจวัด” (Instrument Reading) ซึ่งเป็นความสามารถที่พัฒนาขึ้นจากการร่วมมืออย่างใกล้ชิดกับ Boston Dynamics [1, 7] ในสภาพแวดล้อมทางอุตสาหกรรม หุ่นยนต์มักต้องตรวจสอบค่าต่าง ๆ จากเกจวัดแรงดัน (Pressure Gauges) หรือกระจกวัดระดับ (Sight Glasses) ซึ่งมีความซับซ้อนทั้งในแง่ของรูปร่าง ตัวเลข และตำแหน่ง [1, 7]

ก่อนหน้าเวอร์ชันนี้ หุ่นยนต์มักประสบปัญหาในการอ่านค่าเหล่านี้เนื่องจากความคลาดเคลื่อนของมุมมองหรือแสงสะท้อน แต่ Gemini Robotics-ER 1.6 สามารถจดจำและตีความค่าเหล่านี้ได้อย่างแม่นยำ [7] ความสามารถนี้เปิดประตูสู่การใช้งานในโรงงานอุตสาหกรรมที่ต้องการความแม่นยำสูง เช่น การตรวจสอบเครื่องจักรหรือระบบท่อส่งพลังงาน ซึ่งก่อนหน้านี้ต้องพึ่งพาการตรวจสอบด้วยมนุษย์เป็นหลัก [7]

ความปลอดภัยและข้อจำกัดทางกายภาพ

Google DeepMind เน้นย้ำว่า Gemini Robotics-ER 1.6 เป็นรุ่นที่ “ปลอดภัยที่สุด” ในตระกูล ER จนถึงปัจจุบัน [2, 4] โมเดลนี้ได้รับการฝึกฝนให้เข้าใจและปฏิบัติตามนโยบายความปลอดภัยอย่างเคร่งครัด โดยสามารถ “คาดการณ์และหลีกเลี่ยง” สิ่งกีดขวางหรืออันตรายได้ล่วงหน้า [2, 4] นอกจากนี้ โมเดลยังเข้าใจข้อจำกัดทางกายภาพ (Physical Constraints) ของหุ่นยนต์เอง เช่น การไม่พยายามยกวัตถุที่หนักเกิน 20 กิโลกรัม ซึ่งช่วยป้องกันความเสียหายต่อหุ่นยนต์และสภาพแวดล้อม [4]

ความสามารถในการ “ตรวจจับความสำเร็จของงาน” (Success Detection) ยังได้รับการปรับปรุงให้ดีขึ้น โดยโมเดลสามารถวิเคราะห์ภาพจากกล้องหลายมุมมอง (Multi-view Understanding) เพื่อตัดสินใจว่างานเสร็จสมบูรณ์หรือไม่ แม้ในสภาพแวดล้อมที่วุ่นวายและมีสิ่งของวางระเกะระกะ [4, 6] ซึ่งช่วยลดความจำเป็นในการให้มนุษย์ตรวจสอบงานทุกครั้ง

การใช้งานจริงกับ Boston Dynamics Spot

เพื่อแสดงให้เห็นถึงศักยภาพของโมเดล Boston Dynamics ได้นำ Gemini Robotics-ER 1.6 ไปติดตั้งในหุ่นยนต์ Spot ซึ่งเป็นหุ่นยนต์สี่ขาที่นิยมใช้ในงานตรวจสอบโรงงาน [2, 8] ในการสาธิต หุ่นยนต์ Spot สามารถอ่านรายการสิ่งที่ต้องทำที่เขียนด้วยมือ (Handwritten To-do Lists) และระบุอันตรายในโรงงานเช่น “น้ำท่วมขัง” ได้ [8]

Marco da Silva รองประธานและผู้จัดการทั่วไปของ Spot ที่ Boston Dynamics กล่าวว่า การนำ Gemini Robotics-ER 1.6 มาใช้ถือเป็นก้าวสำคัญที่ทำให้หุ่นยนต์สามารถ “ทำงานในโลกทางกายภาพ” ได้อย่างมีประสิทธิภาพมากขึ้น [8] การบูรณาการนี้แสดงให้เห็นว่าโมเดลสามารถทำงานร่วมกับระบบควบคุมหุ่นยนต์ที่มีอยู่ได้อย่างราบรื่น [8]

ข้อจำกัดและการท้าทายที่ยังคงอยู่

แม้ว่าจะมีความก้าวหน้าอย่างมาก แต่การสาธิต Gemini Robotics-ER 1.6 ยังเผยให้เห็นข้อจำกัดด้าน “การทำงานทางกายภาพ” (Physical Execution) [8] ในหนึ่งของการสาธิต หุ่นยนต์ Spot พยายามหยิบกระป๋องแต่กลับ “จับในแนวขวาง” (Sideways) แทนที่จะจับในแนวตั้ง ซึ่งทำให้ไม่สามารถยกกระป๋องได้อย่างมีประสิทธิภาพ [8]

เหตุการณ์นี้ชี้ให้เห็นว่า แม้โมเดลจะสามารถ “เข้าใจ” และ “วางแผน” การหยิบจับได้ดี แต่การ “ปฏิบัติ” ให้ถูกต้องตามหลักฟิสิกส์และกลไกของหุ่นยนต์ยังคงเป็นเรื่องที่ท้าทาย [8] ความเข้าใจทางกายภาพแบบมนุษย์ (Human-like Physical Understanding) ยังไม่สมบูรณ์ และจำเป็นต้องมีการพัฒนาอัลกอริทึมควบคุมการเคลื่อนไหว (Motion Control) ให้ดีขึ้นควบคู่ไปกับโมเดลภาษาภาพ [8]

การเข้าถึงสำหรับนักพัฒนา

Gemini Robotics-ER 1.6 เปิดให้นักพัฒนาเข้าถึงผ่าน Gemini API และ Google AI Studio แล้ว [1, 7] Google ระบุว่านักพัฒนาสามารถอัปเกรดจากเวอร์ชัน 1.5 เป็น 1.6 ได้ง่าย ๆ เพียงเปลี่ยนชื่อโมเดลในคำสั่ง API โดยไม่ต้องปรับโครงสร้างโค้ดใหม่ [5] ซึ่งช่วยลดอุปสรรคในการนำโมเดลไปใช้งานจริง [5]

การเปิดตัว Gemini Robotics-ER 1.6 สะท้อนให้เห็นถึงทิศทางของ Google DeepMind ในการผลักดันให้ AI ไม่ใช่แค่ “คิด” ได้ แต่ “เข้าใจ” และ “โต้ตอบ” กับโลกทางกายภาพได้อย่างมีประสิทธิภาพ [1, 7] แม้จะยังมีข้อจำกัดด้านการทำงานทางกายภาพ แต่ความสามารถในการอ่านเกจวัดและวางแผนการเคลื่อนไหวที่ปลอดภัยถือเป็นก้าวสำคัญสู่การใช้งานหุ่นยนต์ในอุตสาหกรรมอย่างแพร่หลาย [7, 8]

สรุป

Gemini Robotics-ER 1.6 เป็นโมเดลภาษาภาพที่มุ่งเน้นการเพิ่มความสามารถในการให้เหตุผลเชิงกายภาพให้หุ่นยนต์ [1, 7] ด้วยความสามารถพิเศษในการอ่านเกจวัดและความปลอดภัยที่สูงขึ้น โมเดลนี้เปิดโอกาสใหม่ ๆ ในการใช้งานหุ่นยนต์ในอุตสาหกรรม [7, 8] แม้จะยังมีข้อจำกัดด้านการทำงานทางกายภาพ แต่การอัปเกรดนี้ถือเป็นก้าวสำคัญในการทำให้หุ่นยนต์สามารถทำงานในโลกจริงได้อย่างมีประสิทธิภาพ [8, 7]

Sources

- Gemini Robotics ER 1.6: Enhanced Embodied Reasoning (deepmind.google) — 2026-04-14

- Google DeepMind Releases Gemini Robotics-ER 1.6 with Embodied Reasoning | Marc Theermann posted on the topic | LinkedIn (www.linkedin.com) — 2026-04-27

- Spot robot gets Gemini AI to boost real-world inspection tasks (interestingengineering.com) — 2026-04-15

- Gemini Robotics-ER 1.6 | Gemini API | Google AI for Developers (ai.google.dev) — 2026-05-01